将 ChatGPT 与 Auto-GPT 和 GPT-Engineer 等自主 AI 代理进行比较时,决策过程中出现了显着差异。虽然 ChatGPT 需要人类积极参与来推动对话,根据用户提示提供指导,但规划过程主要依赖于人类干预。

像 Transformer 这样的生成式人工智能模型是最先进的核心技术,驱动着这些自主人工智能代理。这些变压器经过大型数据集的训练,使它们能够模拟复杂的推理和决策能力。

自治代理的开源根源:Auto-GPT 和 GPT-Engineer

许多自主人工智能代理都源于由创新人士领导的开源计划,这些计划改变了传统的工作流程。Auto-GPT 等代理不仅可以提供建议,还可以独立处理从在线购物到构建基本应用程序的任务。OpenAI 的代码解释器旨在将ChatGPT从仅仅提出想法升级为利用这些想法积极解决问题。

Auto-GPT和GPT-Engineer都配备了GPT 3.5和GPT-4的强大功能。它掌握代码逻辑,组合多个文件,并加速开发过程。

Auto-GPT 功能的关键在于其人工智能代理。这些代理被编程来执行特定的任务,从调度等普通任务到需要战略决策的更复杂的任务。然而,这些人工智能代理在用户设定的边界内运行。通过 API 控制访问,用户可以确定人工智能可以执行的操作的深度和范围。

例如,如果负责创建与 ChatGPT 集成的聊天 Web 应用程序,Auto-GPT 会自动将目标分解为可操作的步骤,例如创建 HTML 前端或编写 Python 后端脚本。当应用程序自动生成这些提示时,用户仍然可以监视和修改它们。正如AutoGPT的创建者@SigGravitas所示,它能够构建并执行基于Python的测试程序。

虽然下图描述了自主人工智能代理的更通用的架构,但它提供了对幕后流程的宝贵见解。

该过程是通过验证 OpenAI API 密钥并初始化各种参数(包括短期内存和数据库内容)来启动的。一旦关键数据传递给代理,模型就会与 GPT3.5/GPT4 交互以检索响应。然后,该响应会转换为 JSON 格式,代理会解释该格式以执行各种功能,例如进行在线搜索、读取或写入文件,甚至运行代码。Auto-GPT 采用预先训练的模型将这些响应存储在数据库中,未来的交互将使用这些存储的信息作为参考。循环继续,直到任务被认为完成。

Auto-GPT 和 GPT-Engineer 设置指南

设置 GPT-Engineer 和 Auto-GPT 等尖端工具可以简化您的开发流程。以下是帮助您安装和配置这两个工具的结构化指南。

自动GPT

设置 Auto-GPT 可能看起来很复杂,但通过正确的步骤,它会变得简单。本指南介绍了设置 Auto-GPT 的过程,并提供了对其不同场景的见解。

1.先决条件:

- Python 环境:确保安装了 Python 3.8 或更高版本。您可以从其官方网站获取Python 。

- 如果您计划克隆存储库,请安装Git。

- OpenAI API 密钥:要与 OpenAI 交互,需要 API 密钥。从您的OpenAI 帐户获取密钥

内存后端选项:内存后端充当 AutoGPT 的存储机制,用于访问其操作的基本数据。AutoGPT 采用短期和长期存储功能。Pinecone、Milvus、Redis等是可用的选项。

2. 设置您的工作区:

- 创建虚拟环境:

python3 -m venv myenv - 激活环境:

- MacOS 或 Linux:

source myenv/bin/activate

- MacOS 或 Linux:

3、安装:

- 克隆 Auto-GPT 存储库(确保已安装 Git):

git clone https://github.com/Significant-Gravitas/Auto-GPT.git - 为了确保您使用的是Auto-GPT 0.2.2版本,您需要签出该特定版本:

git checkout stable-0.2.2 - 导航到下载的存储库:

cd Auto-GPT - 安装所需的依赖项:

pip install -r requirements.txt

4、配置:

- 找到

.env.template主/Auto-GPT目录。复制并重命名为.env - 打开

.env并在旁边设置您的 OpenAI API 密钥OPENAI_API_KEY= - 同样,要使用 Pinecone 或其他内存后端,请使用

.env您的 Pinecone API 密钥和区域更新文件。

5. 命令行说明:

Auto-GPT 提供了一组丰富的命令行参数来自定义其行为:

- 一般用法:

- 显示帮助:

python -m autogpt --help - 调整人工智能设置:

python -m autogpt --ai-settings <filename> - 指定内存后端:

python -m autogpt --use-memory <memory-backend>

- 显示帮助:

6.启动自动GPT:

配置完成后,使用以下命令启动 Auto-GPT:

- Linux 或 Mac:

./run.sh start - 窗户:

.\run.bat

Docker 集成(推荐设置方法)

对于那些希望将 Auto-GPT 容器化的人来说,Docker 提供了一种简化的方法。但是,请注意 Docker 的初始设置可能有点复杂。请参阅Docker 的安装指南以获取帮助。

请按照以下步骤修改 OpenAI API 密钥。确保 Docker 在后台运行。现在转到 AutoGPT 的主目录并在终端上执行以下步骤

- 构建 Docker 镜像:

docker build -t autogpt . - 现在运行:

docker run -it --env-file=./.env -v$PWD/auto_gpt_workspace:/app/auto_gpt_workspace autogpt

使用 docker-compose:

- 跑步:

docker-compose run --build --rm auto-gpt - 对于补充自定义,您可以集成其他参数。例如,要同时使用 –gpt3only 和 –continuous 运行:

docker-compose run --rm auto-gpt --gpt3only--continuous - 鉴于 Auto-GPT 在从大型数据集生成内容方面拥有广泛的自主权,因此存在无意访问恶意网络源的潜在风险。

为了降低风险,请在虚拟容器(例如 Docker)中运行 Auto-GPT。这可确保任何潜在有害内容都限制在虚拟空间内,从而使您的外部文件和系统不受影响。或者,Windows Sandbox 是一个选项,但它会在每次会话后重置,无法保留其状态。

为了安全起见,请始终在虚拟环境中执行 Auto-GPT,以确保您的系统免受意外输出的影响。

鉴于这一切,您仍然有可能无法获得您想要的结果。Auto-GPT 用户报告在尝试写入文件时反复出现问题,经常遇到由于文件名有问题而导致尝试失败的情况。这是一个这样的错误:Auto-GPT (release 0.2.2) doesn't append the text after error "write_to_file returned: Error: File has already been updated

相关的GitHub 线程上已经讨论了解决此问题的各种解决方案,以供参考。

GPT-工程师

GPT-工程师工作流程:

- 提示定义:使用自然语言详细描述您的项目。

- 代码生成:根据您的提示,GPT-Engineer 开始工作,生成代码片段、函数,甚至完整的应用程序。

- 细化和优化:生成后,总是有增强的空间。开发人员可以修改生成的代码以满足特定要求,确保一流的质量。

设置 GPT-Engineer 的过程已被浓缩为易于遵循的指南。以下是逐步细分:

1. 准备环境:在开始之前,请确保您已准备好项目目录。打开终端并运行以下命令

- 创建一个名为“网站”的新目录:

mkdir website- 移动到目录:

cd website

2. 克隆存储库: git clone https://github.com/AntonOsika/gpt-engineer.git .

3. 导航并安装依赖项:克隆后,切换到目录cd gpt-engineer 并安装所有必需的依赖项make install

4. 激活虚拟环境:根据您的操作系统,激活创建的虚拟环境。

- 对于macOS/Linux:

source venv/bin/activate

- 对于Windows,由于 API 密钥设置而略有不同:

set OPENAI_API_KEY=[your api key]

5. 配置 – API 密钥设置:要与 OpenAI 交互,您需要一个 API 密钥。如果您还没有,请在 OpenAI 平台上注册,然后:

- 对于macOS/Linux:

export OPENAI_API_KEY=[your api key]

- 对于Windows(如前所述):

set OPENAI_API_KEY=[your api key]

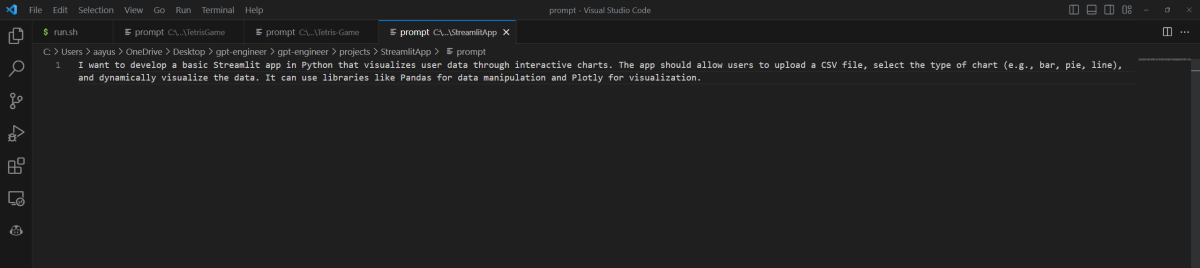

6. 项目初始化和代码生成: GPT-Engineer 的魔力从文件夹main_prompt 中找到的文件开始projects 。

- 如果您想开始一个新项目:

cp -r projects/example/ projects/website

在这里,将“网站”替换为您选择的项目名称。

- 使用您选择的文本编辑器编辑

main_prompt文件,记下项目的要求。

- 一旦您对提示符感到满意,请运行:

gpt-engineer projects/website

您生成的代码将驻留在workspace 项目文件夹内的目录中。

7. 后一代:虽然 GPT-Engineer 很强大,但它可能并不总是完美的。检查生成的代码,根据需要进行任何手动更改,并确保一切顺利运行。

运行示例

迅速的:

与 Auto-GPT 非常相似,GPT-Engineer 即使在完成设置后有时也会遇到错误。然而,在第三次尝试时,我成功访问了以下精简版网页。确保您查看官方GPT-Engineer 存储库的问题页面上的任何错误。

当前人工智能代理的瓶颈

运营费用

Auto-GPT 执行的单个任务可能涉及多个步骤。重要的是,每个步骤都可以单独计费,从而增加了成本。自动 GPT 可能会陷入重复循环,无法提供承诺的结果。此类事件会损害其可靠性并损害投资。

想象一下想要使用 Auto-GPT 创建一篇短文。论文的理想长度是 8K 令牌,但在创建过程中,模型会深入研究多个中间步骤来最终确定内容。如果您使用上下文长度为 8k 的 GPT-4,则对于输入,您将需要支付0.03 美元。对于输出,成本为0.06 美元。现在,假设模型遇到了不可预见的循环,多次重做某些部分。不仅流程变得更长,而且每次重复也会增加成本。

为了防止这种情况:

在OpenAI Billing & Limits中设置使用限制:

- 硬限制:限制使用量超出您设定的阈值。

- 软限制:一旦达到阈值,就会向您发送电子邮件警报。

功能限制

正如其源代码中所述,Auto-GPT 的功能有一定的界限。其解决问题的策略由其内在功能和 GPT-4 API 提供的可访问性决定。如需深入讨论和可能的解决方法,请考虑访问:Auto-GPT 讨论。

人工智能对劳动力市场的影响

人工智能和劳动力市场之间的动态不断变化,本研究论文对此进行了广泛记录。一个关键的结论是,虽然技术进步通常有利于熟练工人,但它给从事日常任务的人带来了风险。事实上,技术进步可能会取代某些任务,但同时为多样化的劳动密集型任务铺平了道路。

据估计,80% 的美国工人可能会发现 LLM(语言学习模型)影响他们大约 10% 的日常任务。这一统计数据强调了人工智能和人类角色的融合。

人工智能在劳动力中的双重作用:

- 积极的方面:人工智能可以自动执行大量任务,从客户服务到财务建议,为缺乏专业团队资金的小型企业提供了喘息的机会。

- 担忧:自动化的好处引起了人们对潜在失业的担忧,特别是在人类参与至关重要的领域,例如客户支持。除此之外,还有与人工智能访问机密数据相关的道德迷宫。这就需要强大的基础设施来确保人工智能的透明度、问责制和道德使用。

结论

显然,ChatGPT、Auto-GPT 和 GPT-Engineer 等工具处于重塑技术与其用户之间交互的最前沿。这些人工智能代理植根于开源运动,体现了机器自治的可能性,简化了从调度到软件开发的任务。

随着我们进入人工智能更深入地融入我们日常生活的未来,拥抱人工智能的能力和保护人类角色之间的平衡变得至关重要。从更广泛的角度来看,人工智能劳动力市场的动态描绘了增长机遇和挑战的双重形象,要求有意识地整合技术道德和透明度。

ChatGPT、ChatGPT中国站、国内ChatGPT、人工智能、AI、OpenAI、ChatGPT国内、ChatGPT官网、ChatGPT中文版、ChatGPT体验、ChatGPT国内站点、ChatGPT中文网、ChatGPT国内、中国版ChatGPT、ChatGPT中国镜像、ChatGPT国内镜像、AI全家桶、AI导航、MJ绘画、AI绘画技术、人工智能绘画、AI艺术创作、智能绘图软件