上周,谷歌推出了新的人工智能,或者更确切地说是新的大语言模型,称为Gemini。Gemini 1.0 模型有三个版本:Gemini Nano 应该最适合特定设备上的任务,Gemini Pro 应该是更广泛任务的最佳选择,而 Gemini Ultra 是 Google 最大的语言模型将处理您可以交给它的最复杂的任务。

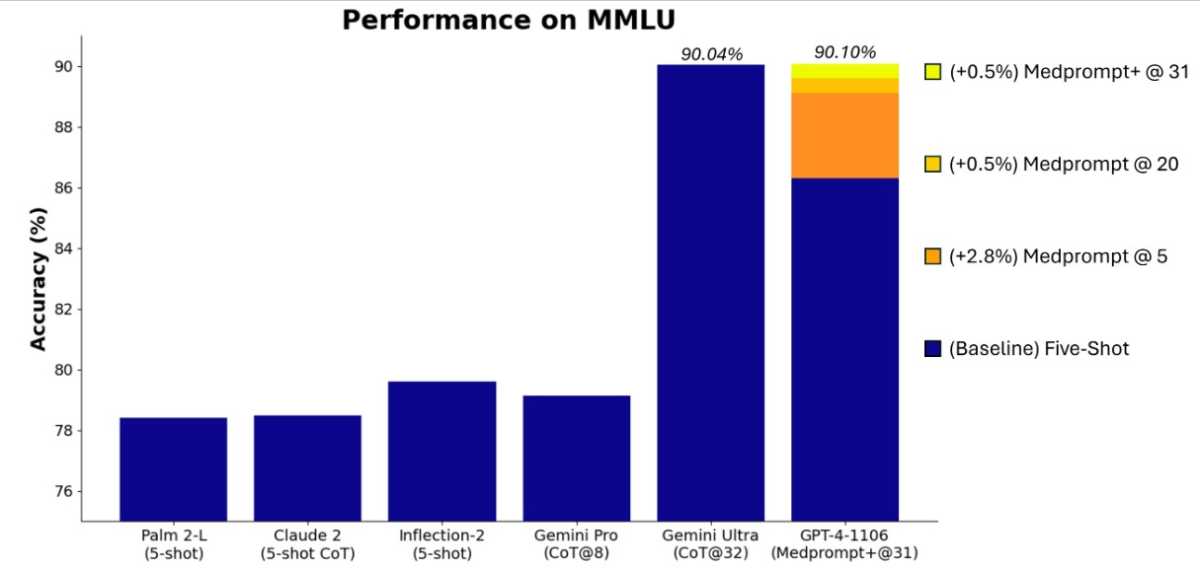

谷歌在发布 Gemini Ultra 时热衷强调的是,该语言模型在 32 种最常用的衡量语言模型能力的测试中,有 30 种表现优于 OpenAI 最新版本的 GPT-4。测试涵盖从阅读理解和各种数学问题到为 Python 和图像分析编写代码的所有内容。在一些测试中,两种人工智能模型之间的差异只有零点几个百分点,而在其他测试中则高达十个百分点。

谷歌

然而,也许 Gemini Ultra 最令人印象深刻的成就是,它是第一个在大规模多任务语言理解 (MMLU) 测试中击败人类专家的语言模型,在测试中,Gemini Ultra 和专家面临 57 个不同领域的问题解决任务,包括数学和物理到医学、法律和伦理学。Gemini Ultra 的得分达到了 90.0%,而与之相比的人类专家“仅”得分为 89.8%。

Gemini 的推出将是渐进的。上周,Gemini Pro 向公众开放,谷歌的聊天机器人 Bard 开始使用该语言模型的修改版本,并且 Gemini Nano 内置于谷歌 Pixel 8 Pro 智能手机上的许多不同功能中。Gemini Ultra 尚未准备好向公众推出。谷歌表示,它仍在接受安全测试,并且仅与少数开发人员和合作伙伴以及人工智能责任和安全专家共享。然而,我们的想法是在明年初推出时通过 Bard Advanced 向公众提供 Gemini Ultra。

微软现在反驳了谷歌的说法,即 Gemini Ultra 可以通过让 GPT-4 再次运行相同的测试来击败 GPT-4,但这次的提示或输入略有修改。微软研究人员于 11 月发表了一项名为Medprompt 的研究,该研究混合了不同的策略,将提示输入到语言模型中以获得更好的结果。您可能已经注意到,当您稍微更改措辞时,从 ChatGPT 获得的答案或从 Bing 图像创建器获得的图像会略有不同。这个概念,但更先进,是 Medprompt 背后的想法。

微软

通过使用 Medprompt,微软成功地使 GPT-4 在 Google 之前强调的 30 项测试中表现优于 Gemini Ultra,其中包括 MMLU 测试,其中使用 Medprompt 输入的 GPT-4 获得了 90.10% 的分数。未来哪种语言模型将占据主导地位还有待观察。人工智能王座之争还远未结束。

本文从瑞典语翻译成英语,最初发表在 pcforalla.se 上。