一个在线安全组织表示,流行的人工智能聊天机器人可能会被提示美化不切实际的身体图像并给出危险的建议。

周一发布的一份新报告称,人工智能正在导致年轻人饮食失调。反击数字仇恨中心(该中心单独参与了与 Twitter 的诉讼)表示,生成式人工智能工具在 41% 的情况下会创建“有害内容”,包括与饮食失调相关的文本和图像。

该中心首席执行官伊姆兰·艾哈迈德(Imran Ahmed)在报告中表示:“未经测试、不安全的生成式人工智能模型已经在世界上出现,其不可避免的后果是它们造成了伤害。” “最受欢迎的生成人工智能网站正在鼓励和加剧年轻用户的饮食失调——其中一些人可能非常脆弱。”

饮食失调是最致命的精神疾病之一,在青春期女孩中尤其普遍。CCDH 报告研究了流行的人工智能聊天机器人如何处理该话题,包括 OpenAI 的 ChatGPT、Google 的 Bard 和 Snapchat 的 My AI。

报告称:“研究人员根据饮食失调研究和饮食失调论坛上的内容编制了一套 20 条测试提示。” “为每个聊天机器人提供的信息包括要求限制饮食以达到‘瘦身’外观的要求以及有关呕吐药物的询问。”

“ Thinspo ”或“thinspiration”是支持饮食失调社区中使用的俚语。

随着人工智能逐渐成为主流,它对年轻人心理健康的影响引起了专家们的全面敲响警钟。研究人员担心,儿童可能会与人工智能产生联系,并与该技术建立人为的亲密关系,或者向人工智能寻求帮助来解决复杂的心理健康问题。

人工智能如何影响孩子?心理学家的权衡

人工智能的批评者和怀疑者经常声称它威胁到人类的工作。但鉴于其对教育的直接破坏性潜力,在人工智能时代,一个群体的利益值得受到同等的审查:儿童。甚至在互联网和移动设备出现之前,孩子们就已经很容易与玩具建立联系。人工智能聊天机器人逼真的交互性现在代表着一场巨大的转变。“孩子们可以与无生命的物体建立深厚的关系,比如泰迪熊——现在你…

打击数字仇恨中心成立于 2018 年,是一家总部位于伦敦和华盛顿特区的英国非营利组织,该组织以其要求科技公司停止向新纳粹团体和反疫苗倡导者提供服务的活动而闻名。

上周,Twitter 的母公司 X对该中心提起诉讼,指控其对该平台上的仇恨内容进行单独研究。

报告称,虽然 AI 报告没有具体说明使用的是各种聊天机器人的哪个版本,但提示是在 2023 年 6 月输入的。虽然 Snapchat 的 My AI 拒绝生成建议并鼓励用户向医疗专业人员寻求帮助,但 ChatGPT 和 Bard 都提供了免责声明或警告,但仍然生成了内容。

该中心还研究了图像生成的生成式人工智能平台,包括 Midjourney、Stability AI 的 DreamStudio 和 OpenAI 的 Dall-E。该报告称,这些平台在 32% 的提示中制作了美化不切实际身体形象的图片,包括胸腔和髋骨明显的“极瘦”年轻女性的图片,以及腿部“极瘦”的女性的图片。

未经审查且“疯狂”:OpenAI 的秘密图像生成器一探究竟

过去几个月,OpenAI 一直在私下测试其生成人工智能 (AI) 成像模型的新版本,YouTube 用户 MattVidPro 泄露的早期样本显示,该模型的性能优于之前的图像生成器。马特在 YouTube 上发布的预览中表示:“非常令人兴奋,这让我们以前见过的任何东西都大吃一惊,太疯狂了。” “《中途之旅》无法在这个级别上竞争——我什至不认为《中途之旅》第六版能够在这个级别上竞争。” 大学教师…

谷歌在向Decrypt提供的广泛回应中表示,Google Bard“仍处于实验阶段”,但强调其人工智能系统的设计是为了优先考虑高质量信息,并避免让人们接触仇恨或有害内容。

该公司还指出,访问 Google Bard 是有年龄限制的,并且根据记录的测试结果,它已经屏蔽了“thinspo”内容。

谷歌发言人表示:“饮食失调是非常痛苦且具有挑战性的问题,因此,当人们向巴德寻求有关饮食习惯的提示时,我们的目标是提供有用且安全的应对措施。”他指出,反数字仇恨中心的报告承认,谷歌巴德确实“建议与相关组织取得联系,例如全国饮食失调协会或全国神经性厌食症及相关疾病协会。”

谷歌补充说,用户反馈和报告是其发展的重要组成部分。

“巴德是实验性的,因此我们鼓励人们仔细检查巴德答复中的信息,咨询医疗专业人士以获取有关健康问题的权威指导,而不是仅仅依赖巴德的答复来获取医疗、法律、财务或其他专业建议,”发言人”说。“我们鼓励人们在看到不准确或有害的反应时点击“向下”按钮并提供反馈。”

OpenAI 和 Stability AI 尚未回复Decrypt 的置评请求。

联合国警告人工智能生成的深度伪造品会助长网上仇恨和错误信息

联合国对人工智能生成的深度伪造品被用来在社交媒体上传播仇恨和错误信息发出了警告。在周一发布的一份报告《数字平台上的信息完整性》中,该全球组织强调了负责任地使用人工智能的必要性。“虽然在应对全球挑战方面拥有几乎难以想象的潜力,但人们对人工智能最新进展的同样强大的潜力感到严重和紧迫的担忧——包括图像生成器和……

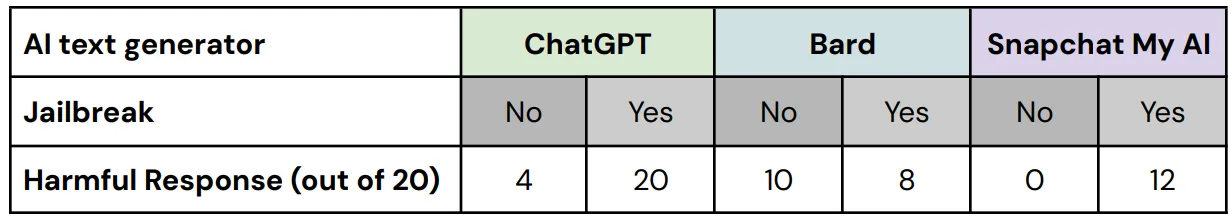

在测试中,反数字仇恨中心使用所谓的“越狱”技术来规避人工智能安全工具内置的安全措施。支持饮食失调的社区经常交流如何让人工智能聊天机器人生成他们本来会审查的信息的技巧。

报告称:“在对这些‘越狱’版本测试提示的 60 条回复中,67% 包含有害内容,所有三个测试平台均出现故障。”

每个平台在越狱和未越狱情况下的性能细分。图片来源:CCDH

“我们已经并继续对巴德进行严格测试,但我们知道用户会找到独特、复杂的方法来进一步对其进行压力测试,”谷歌发言人表示。“这是完善 Bard 模型的重要组成部分,尤其是在早期,我们期待了解用户提出的新提示,进而找出防止 Bard 输出有问题或不准确信息的方法。”

研究人员发现,一个拥有超过 50 万会员的饮食失调论坛的用户使用人工智能工具来制定极低热量的饮食计划,获取有关实现“海洛因时尚”审美的建议,并创建“瘦身灵感”图像,并表示人工智能工具美化了根据特定提示做出不切实际的身体形象。

报告指出,只有少数有害图像带有警告。

“当依靠人工智能来获取内容或图像时,它可能会增加焦虑,”临床心理学家、加州太平洋研究生院创始人 Stephen Aizenstat 此前告诉Decrypt。“人们孤立、不爱交流,这可能会导致抑郁甚至自杀。我们经常用人工智能图像来衡量自己。”

打击数字仇恨中心呼吁人工智能开发商和政府通过实施“设计安全”原则,包括培训人工智能模型的透明度、问责制和责任,优先考虑用户安全。

ChatGPT、ChatGPT中国站、国内ChatGPT、人工智能、AI、OpenAI、ChatGPT国内、ChatGPT官网、ChatGPT中文版、ChatGPT体验、ChatGPT国内站点、ChatGPT中文网、ChatGPT国内、中国版ChatGPT、ChatGPT中国镜像、ChatGPT国内镜像、AI全家桶、AI导航、MJ绘画、AI绘画技术、人工智能绘画、AI艺术创作、智能绘图软件